AIと人間の脳:認知発達の未来を探る

人間の知的能力の根幹をなすのが言語の習得だ。

しかし、私たちがどのようにして言語を習得し、活用しているかというメカニズムは、まだ多くの謎に包まれている。

宮崎産業経営大学の岡夏樹教授は、この人間の言語習得プロセスを、人工知能(AI)の構築を通して解明しようと取り組んでいる。

岡教授は独自のAIシステム分析法を開発し、言語獲得メカニズムを探る研究をしている。

なぜ人間は言語を自然に習得できるのか?そのメカニズムの解明は、認知科学の根幹に関わる重要な課題だ。

このインタビューでは、認知科学とAI研究の最前線に注目し、知能研究の新たな地平を読者にお届けする。

言語習得AIの研究から解き明かす、人間知能の本質

―――まずは、研究領域について教えてください。

私の研究内容は、人工知能(AI)の構築を通して、人の知能、特に言語に関する知能の仕組みを解明することです。

知能の解明には心理学、言語学、脳科学、人工知能、哲学など多くの分野が関わっており、様々なアプローチがありますが、私が採用しているのは構成的解明です。AIを実際に作って動かすことで、人の知能の仕組みに迫ろうというアプローチです。

構成的解明を目指す研究者は、実際に人工知能システムを作り動かすことに注力します。単に実験観察して分析するのと違い、システムを動かすためには細かい仕様を具体的に決める必要があり、その過程で思索が深まります。動作可能になったら、システムの振る舞いのレベルで人の知的行動を再現できるか(人と同じように発話したり行動したりできるか、視線の動きや反応時間が一致するか)を、心理学等の知見に照らし合わせて詳細に検討します。

さらに、そうした振る舞いの比較だけでなく、人工知能システムの内部構造や情報処理過程についても、脳活動計測などの知見と矛盾しないかを確認します。 これらの方法で、人の知能の仕組みをモデル化できている可能性を高めていくのが、構成的解明の特徴的なアプローチです。振る舞いや内部の動きが人と一致すれば、妥当なモデルが構築できた可能性が高いという訳です。

ただし、人と完全に同一の知能を実現するのは極めて困難です。そのため、研究者は人と全く「同じ」ではなく、知能の一部に注目し、その注目した観点において人とできるだけ「似ている」知能システムの構築を目指すことになります。そうした意味で、人の知能全体の解明はまだ遠い先ですが、いろいろな方向から一歩ずつ近づいていこうというのが研究の現状です。

なお、結果として人と仕組みが異なることが分かったとしても、AIを構築しその動作の仕組みを明らかにすることで、人の知能が持つ本質的な性質を浮き彫りにし、その仕組みに迫る手がかりが得られる可能性があります。人にできてAIにはできないことはまだ多く残っていますが、その差異を一つずつ埋めていく過程で、知能の解明が進むと期待しています。

知能の中で私がなぜ言語に注目しているのかというと、他の動物と比べた場合、言語が人の知能の大きな特徴だと考えているからです。

言語と関連する部分的な能力は一部の動物も備えていると考えられますが、人の言語を人と同様に理解し、生成し、言語を用いて推論する能力は人間にしか備わっていないと考えられており、人間の知的活動の基盤となっています。人間の言語能力は動物でも備えている基礎的な能力を土台にしつつ、それを発展させたものだと考えられます。

これまでは、言語理解や言語生成の複雑な機能を人工的に実現するのは難しかったのですが、近年の大規模言語モデルの登場により、AIによる言語処理が急速に人のレベルに近づき、流ちょうに対話する生成AIも生まれました。現在、生成AIが人間と見まがうような言語能力を示すことは大きな注目を集めています。

生成AIのように高いレベルで言葉を操る人工システムを作れたことは人類史上画期的な成果ですが、その仕組みはまだ明らかになっていません。生成AIは非常に複雑なシステムであり、その内部メカニズムを完全に解明するのは容易ではありません。ブラックボックスの部分も多く、研究者たちも戸惑っている状況です。

AIの性能が劇的に高まったこのタイミングで、生成AIの言語処理の仕組みを明らかにし、さらに人の言語能力の解明につなげることは大変重要な研究テーマだと考えています。

従来のAIは、人間が事前に分析して定義したルールに基づいて言語処理を行っていたため、定型的な処理しかできず、質の高い言語理解・生成は困難でした。 そこで、いきなり大人のレベルは作れないのであれば、発達させるのはどうかということで、人間の言語発達過程をモデルにした「発達させる」アプローチが生まれました。 赤ちゃんが徐々に言語能力を身につけていくのと同様に、AIシステムも段階的に言語処理能力を高めていく、という発想です。私もこの流れで研究を進めてきました。

しかし、人が全て設計するアプローチや発達アプローチによる到達点を、いきなり超えるレベルの言語処理が、大規模言語モデル-生成AIの流れで実現されてしまったというのが、今の状況です。大量のパラメータを持つ巨大なモデルで、極めて大量の言語データから次の単語を予測するという形で学習させることで、一気に人間のように流ちょうな言語処理能力を獲得してしまいました。つまり、発達プロセスを経ずに、基本的には一段階の学習によって高度な言語能力を実現したということです。

ただし、人と比べて桁違いに大量の学習データが必要だという点など、人とは異なる性質を持っているため、発達過程に倣って、少量のデータから効率的に学習できるモデルを作ろうとする動きもあります。

また、とても流ちょうですが、論理的な正確な推論は苦手です。この欠点は「段階的に考えて」などと指示することで緩和します。しかし、事前学習に含まれる内容に関しては筋道だって推論しているように見えますが、初めての内容に対して形式的推論ができる訳ではないことが報告されています。

以上のように、どこまで人と共通かというのは議論のあるところですが、人の知的処理の仕組みを調べるよりもAIの動作の仕組みを調べるほうが易しいと考えられます。その理由は、次の通りです。

2 倫理的な問題なしに様々な条件設定で学習や推論させることができる。

3 電極を刺すことなく内部の動きを調べられる。

②については、たとえば、AIならば極端に偏った言語入力から学習させる、一部の機能を取り去って学習・推論を試してみる、などの実験ができますが、人では事件や事故で普通に育てられなかった、病気や怪我で機能を失った、などの場合にしか同様の知見は得られません。

なお、③についてはAIのほうが有利ではありますが、だからといって容易に知的な働きの仕組みが分かるという訳ではありません。プログラムの1行1行の動作を追うことはできますが、それは極めて大規模で複雑なシステムである生成AIの言語能力の説明には直結しません。また、計算機の回路のレベルで動作を追うこともできますが、それは知的な働きの説明や理解とはさらにレベルが乖離しています。

私たちが普段使っている言葉は内容語(何かを指し示すことにより意味を担う語)と機能語(主に内容語間の文法的関係を表す語)に分けられますが、私は、機能語の一つである終助詞に着目し、話者の心的態度(心理状態、捉え方、伝え方など)の表現といった、コミュニケーションにおいて重要な働きを研究しています。

終助詞は、文の最後に付く小さな言葉ですが、話し手の心的態度を表すという核心的な役割を担っています。言語におけるこうした微細な側面こそ、人間の知的能力の特徴を反映しているのではないかと考えています。

例えば、「情報を伝えたいのか/情報を共有していることを確認したいのか」という意図を区別するのに、終助詞一つで大きな違いが生まれます。前者は終助詞「よ」で表現され、後者は「ね」で表現されます。終助詞なくしては、話し手の本来の意図が相手に伝わらないということです。

言語の中で重要な存在であるにもかかわらず、AIがどのようにして終助詞の理解や使用を実現するかといった点は、ほとんど手つかずの状態でした。

従来の心理実験や脳計測だけでは、発話意図の終助詞による表現のような複雑で微妙な言語処理の仕組みを解明するのは困難でしたが、構成的アプローチであるAIの活用により、新しい知見が得られると期待しています。

―――岡先生が研究を進める中で、特に興味深かった点や新しい発見は何ですか?

生成AIの言語理解・生成メカニズムについて、人間の言語能力との比較を行う中で、ニューラルネットワークのモデルを用いて、言葉と視覚情報や心的状態との関係性を詳しく分析しました。

その過程で、「発話中の終助詞が、AI内部の情報処理(注意に伴う情報の流れ)を制御する働きをしている」という仮説を立てました。

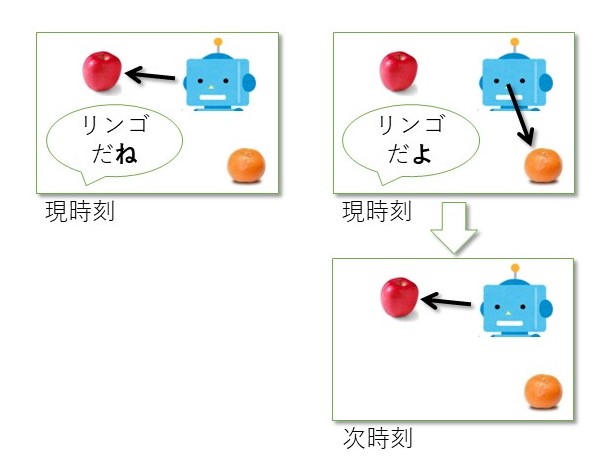

具体的には、「リンゴだよ」と「リンゴだね」では、それぞれの終助詞の存在が、リンゴに対応する感覚情報の予測を変えているという仮説です。

そこで、ロボットに対して様々な状況で「リンゴだよ」や「リンゴだね」と話しかけながら、リンゴを見せるというシミュレーション実験を行いました。 「リンゴだね」は、ロボットがリンゴを見ているときに発話されるが、「リンゴだよ」はロボットがリンゴを見ていないとき発話され、その発話を聞いたロボットは次の時点にリンゴの方を向いてそれを見るといった具合です(下図を参照)。

学習と推論のシミュレーション実験によって、この仮説が正しいことが確認できました。終助詞の違いによって、次に予測される画像情報が異なるということが学習できたということです。

ニューラルネットワークの浅い階層では終助詞からリンゴという単語の表象(内部表現)に情報が伝わり、その後の深い階層でリンゴの画像が予測されるかどうかが制御されている(下図を参照)という、新しい知見が得られました。

参照:主観情報入力型BERTによる発話の意味理解:自己注意の連鎖に注目した内部表現の分析これは、AIの内部メカニズムの解明につながる重要な発見だと言えます。同時に、絶対的な保証はありませんが、人間の言語処理においても、終助詞が同様な役割を果たしている可能性を示唆するものでもあります。

一般的に、AIの言語理解において、内容語(名詞など)とセンサー情報との対応付けは比較的理解しやすい部分です。例えば、「リンゴ」という言葉とリンゴの画像を結び付けることは、深層学習で学習可能です。

しかし、終助詞のような機能語の扱いはより複雑です。機能語は単に何かと対応づけて終わりではなく、より深い情報処理が関与しています。

大規模言語モデルや生成AIではTransformerというモデルが使われていますが、このモデルの特徴は、「注意」と呼ばれる情報処理です。注意によって任意の位置の単語間の情報のやり取りが実現され、高度な言語理解や生成が可能になっています。

終助詞の機能がこの「注意」の「階層」により表現されているというのが私たちが見つけたことです。

先ほどは、終助詞「よ/ね」で、この注意の階層の働きを説明しましたが、機能語が一般的に「内容語間の文法的関係を表す」働きをすることから推測すると、日本語に限らず機能語全般の働きが、注意の階層により表現されている可能性があると考えています。 たとえば、日本語の「おいしそうだ」であれば、機能語である助動詞「そうだ」の情報が「おいし(い)」に伝わり、それが「おいしい」と味覚の対応を制御していることが予想できます。「おいしそうだ」は、他の感覚から味覚を推測する表現ですから、発話時点では「おいしい」という感覚は存在しないことが予想できます。 英語の機能語(冠詞、前置詞、接続詞など)も同様に注意の階層により表現されている可能性が高いでしょう。

これはこれまであまり研究されてこなかったテーマですが、高い言語能力を持つ生成AIを分析することが突破口になり、人の言語能力の解明に近づける可能性を秘めています。

人工知能と人の知能の共通点・相違点

―――人工知能と認知科学の関係性を教えてください。

人工知能研究と認知科学は、お互いに深く関連し合う密接な関係にあります。この両分野は、長年にわたり相互に影響を及ぼし合いながら発展してきました。

まず前提として、人工知能という分野には、研究者によって目的が異なる二つの立場が存在します。

一つは、人間の知能の解明を目指す科学的な立場です。この立場の研究者は、人間の知的処理メカニズムを明らかにすることを主な目的としています。人工知能のシステム開発は、そのための手段として位置づけられます。

一方で、実用的に役立つ知的システムの構築を目指す工学的な立場もあります。この立場の研究者は、人工知能技術を活用した実用的なアプリケーションやサービスの開発を目指しています。

これら二つの立場は、必ずしも完全に分離されているわけではありません。人間知能の解明を目的としつつ、同時に役立つシステムの開発にも取り組む研究者もいます。また、実用システムの開発過程で、人間の知的処理に関する新たな知見が得られる可能性もあります。

認知科学に関しては、計算機による記号操作という概念から始まり、人工知能の研究成果から大きな影響を受けてきました。人工知能のさまざまな概念や手法が、人間の知的処理メカニズムの解明に役立ってきたのです。特にこの1、2年は、生成AIの登場により、AIと人間との違いや共通点についての議論が熱を帯びています。

一方、認知科学の知見も人工知能の研究開発に影響を与えてきました。人間がどのように知的な処理を行っているかという研究成果に基づいて、人工知能システムが設計されてきたのです。例えば、二重過程理論は、AIシステムの設計に影響を与えてきました。

二重過程理論は、人間の思考には二つのタイプがあると説明するものです。一つは無意識で自動的に行われる過程で、物を見て何であるか分かるといった処理がこれに該当します。もう一つは意識的な努力を要する過程で、計画立案などがこれに分類されます。この二重過程をまねたAIシステムが多数設計されてきました。

このように、人工知能と認知科学は密接に関係し合っており、互いに発展を促し、新たな知見を生み出してきました。現在でも、両分野は脳科学、心理学、言語学、哲学など、関連する隣接分野とも連携しながら、発展しています。

―――人間の言語獲得プロセスと今のAIの言語学習プロセスに共通する特徴はありますか?

人間の言語獲得プロセスと今のAIの言語学習プロセスには、いくつかの共通点と相違点が存在します。AIの言語処理技術には長い歴史があり、その変遷の過程で人間の言語獲得プロセスとの共通点や相違点が生まれてきました。

初期のAIの言語処理は、人工無能のようなキーワードに反応するだけのようなものもありましたが、本格的なものとしては研究者や技術者が分析した文法規則や辞書をプログラムで表現することが主流でした。

この方法は文法規則や辞書を使う点で、人間の第二言語獲得と共通点があります。皆さんも文法を習ったり、辞書を引いたりしながら英語を勉強してきたことと思います。

しかし、近年のAIでは、大量の言語事例からの学習が主流となっています。大規模なデータセットを用いて、AIシステムが言語の特徴を学習するのです。人間の乳幼児の言語獲得は、大量の言語事例から統計的な学習を行うという点が今のAIと共通しています。

また、報酬に基づいて学習する強化学習も、人間とAIの両方で活用されています。さらに、近年のAIは視覚、聴覚、行動など、マルチモーダルな入出力を扱うようになり、人間の言語獲得プロセスとの共通性が高まってきています。一部のAIでは、能動的な情報探索も行うようになっています。

一方で大きな相違点の一つは、学習効率の違いです。人間は比較的少数の事例から効率的に言語を獲得できるのに対し、AIはデータの大量消費と膨大なエネルギー消費を必要とします。

また、人間の言語処理は意識的な処理と無意識的な処理の両方を含む(これは二重過程理論に対応しています)のに対し、以前のAI(いわゆる古き良きAI)は主に意識的な処理に相当する部分を、今のAI(大規模言語モデル)は主に無意識的な自動処理に相当する部分を、それぞれ実現してきました。

人の場合、日常的な言語活動の多くの部分は、無意識で自動的に行われていると考えられますが、一貫した話をしたり、事実に基づく話をしたりするためには、意識的な処理の助けが必要だと思われます。さらに、日常的に行うことではなく、国語や英語の授業でやるようなことですが、文法規則を適用して明示的に構文を解析するといったことも人はできます。

これに対して今の生成AIは、人の言語処理能力のうち、無意識の自動的な処理に相当する部分を実現しつつあると見なせます。結果として人と見まがうような流ちょうな言語生成ができるようになりましたが、人が努力して意識的に行うような処理は苦手で、たとえば事実と異なることを平然と述べてしまうといった問題が知られています。

そのため、実用的なシステムを目指す場合は、生成AIに外部ツールを外付けすることで、二重過程に相当する機能を実現しようとしています。具体的には、外付けの検索機能を使って事実を確認したり、計算を別のツールに委ねたりするなどです。

一方、生成AIが苦手な明示的な意識レベルの処理も生成AIで実行できるようにしようとする研究も行われています。筋道だった推論により問題を解く過程の例をAIに示すことや、1ステップずつ考えるように促すプロンプトを用いることで、論理的な推論を正しくできる(ように見える)可能性が高まることが知られています。

私も、指示された手続きに沿った推論(意識レベルの明示的な処理)を、外付けのツールは使わず生成AIにやらせる研究を進めています。こうした研究を通して、科学に残された最大の謎の1つである人の意識の解明や意識を備えたAIの開発に貢献したいと考えています。

AIの歴史から見た今後の可能性と課題、それを踏まえた将来展望

―――AIの研究開発を通して、人間の知能についてどのようなことが分かってきたのでしょうか?

これまでのAI研究の歴史を振り返ると、人間の知性について、いくつかの重要な発見があったことがわかります。

最初はトイ・プロブレムと呼ばれる簡単なゲームやパズルなどの小さい問題を解くことから研究が始まりました。当時は大規模複雑な現実的な問題は解けなかったのですが、これは裏を返せば、そのようなことができるのが人間の知能の特徴として浮かび上がったことになります。

次の段階として、専門家の代わりをすることを目指したエキスパートシステムと呼ばれるAIが研究開発されました。

これは、専門家が持つ専門知識をインタビューなどで抽出し、明示的な規則の形(ルールベース)で表現し、それを用いて推論することで専門家の代わりをさせようとしたもので、ある程度使えるレベルのシステムが多数構築されました。

ただ、こうして作ったシステムは、タスクが少し違うだけで応用が利かず、また、環境や知識の変化に対応できないため、すぐに使われなくなってしまいました。

たとえば医者の代わりであれば、どんどん新しくなる医学知識の進歩についていかないとすぐに陳腐化して使い物になりませんし、工場のシステムも、新商品や新しい材料・部品に対応できなければすぐに役に立たなくなります。

このように柔軟に類推できたり更新し続けたりできるのが人の知識の特徴だということが、この時代に分かったことになります。

また、この時代のエキスパートシステムは特定の狭い領域においては人間の専門家に匹敵する性能を発揮できましたが、一般的な状況への対応力は乏しく、小さな子どもでも簡単にできる日常的な言語理解や物理的状況の理解などができませんでした。

専門家がやることよりも、小さな子どもでもできることのほうが当時のAI(古き良きAI)にとっては難しいことが分かったということになります。単なるルールベースの処理では人間の柔軟な知性を再現できないことが示されたと言えます。

その後、人工ニューラルネットワークを基盤とした深層学習の台頭により、(子どもでもできるがAIには難しかった)画像認識や自然言語処理などの分野で大きな進歩が見られるようになりました。

特に近年の生成AIは、驚くべき汎用性を発揮し、表面的に流ちょうな対話ができるというだけでなく、人が持つ様々な常識をAIが備えていると解釈することを支持するような知的なふるまいが可能になってきています。

これは、大量のデータから特徴量を含めて学習する深層学習や生成AIのアプローチが人の知能の本質的な特徴の少なくとも一部を捉えていることを示唆しています。

しかし一方で、人の知性にはAIではまだ到達できていない側面もあることが明らかになってきました。例えば、人は少ない経験からでも一貫した理解を得られたり、与えられた手順に忠実に従って正確な推論を行えたりするなど、今のAIにはない優れた能力を持っています。

また、創造性や共感性などは今のAIの延長上では実現できないとの見方もあります。実現できるという意見もあり、私もその一人ですが、いずれにせよ、これらも今後の知能研究の重要な課題となっています。

生成AIの動作メカニズムについては依然として不透明な部分が多く、人間の知能との差異も明確ではありません。 研究者の立場として、生成AIと人の知的能力を比較し、両者の動作原理を解明することは非常に意義のある取り組みだと考えており、少しでも今後の発展のために貢献できればと考えています。

―――AIと人間の創造的共存の未来には、どのような可能性がありますか?

AI技術がさらに発展し、人間と遜色ない能力を発揮するようになったときに、人間とうまく協調していけるかどうかは重要な社会課題であり、欠かせない研究課題であると言えます。

AIには、人間と協調して戦争や犯罪、差別や貧困の少ない持続可能な社会を実現できる可能性があります。研究者や一般市民は、このような明るい未来の実現に向けて、AIの適切な活用方法を模索する責任があります。

AI技術は、人間の創造性を高め、より良い世界を実現する手段として活用できる一方で、悪用されれば深刻な影響を及ぼすリスクもあります。AI開発においては、倫理的な配慮と慎重な対応が不可欠です。

私自身研究者としても、このAIの可能性と責任について考え続ける必要があると思っています。AI技術の恩恵を最大限に享受し、同時に弊害を最小限に抑えられるよう、新しい社会システムの構築に向けて尽力していきたいと考えています。

はい

0%

いいえ

0%

はい

0%

いいえ

0%